- Machine: Photoshop

- Créateurs: Thomas Knoll; John Knoll; et al.

- date: 1988-01-01

- Lien: http://www.adobe.com/photoshop/

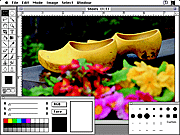

Le plus célèbre des logiciels de traitement d'images s'appelle Photoshop. Il a été conçu à la fin des années 1980 sur la plateforme Macintosh où il est devenu assez rapidement la porte unique pour toute une génération d'infographistes à la recherche de rendus photographiques. Il a été conçu en 1988 sous le nom de « ImagePro », puis rebaptisé en 1990 avec la sortie officielle chez Adobe sous le nom de « Photoshop 1.0 ».

Pour beaucoup de ses utilisateurs, Photoshop est un logiciel complexe, voire un des plus sophistiqués. Mais la réalité est tout autre. Comme beaucoup de logiciels de sa génération, il n'y a qu'une seule métaphore de base, et celle-ci est calqué pratiquement litéralement sur une logique algorithmique interne à la machine : à savoir le array, c'est-à-dire le tableau de valeurs.

Le array existe depuis les tout débuts de l'informatique, à commencer par la Turing Machine. C'est une des structures de base de la machine. Mais pour adapter cette logique à celle du traitement de l'image (qui est différent du simple affichage de l'image) a fallu l'introduction de deux autres logiques diagrammatiques fondamentales.

La prémière, c'est l'introduction de la carte binaire, le « bit-map » (cf. « Waldrop » (

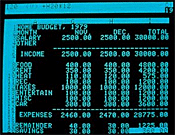

Le deuxième logique nécessaire pour Photoshop serait celle de la manipulation d'ensembles d'entités discrètes, introduit par Dan Bricklin via VisiCalc. Le marriage de ces deux logiques, le pixel et le tableur, permet l'introduction d'une nouvelle machine, Photoshop.

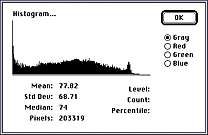

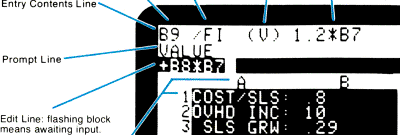

Pour travailler une image, Photoshop commence par importer, voire construire, un tableau de valeurs, chaque case contennant 1 bit, 8 bit, jusqu'à 32 bit d'informations colormétriques (8 bit rouge + 8 bit vert + 8 bit bleu + 8 bit transparence = 4 x 8 bit = 32 bit). Chaque case représente alors un pixel (cf. diagram). Plus qu'il y ait de bits par pixel, plus il y a de nuances de couleur disponibles. C'est une des étapes les plus importantes dans Photoshop, car une fois que nous avons choisit la largeur de notre tableau de valeurs, le reste du travail consitera à remplir chacune des cases avec des numéros représentant notre choix de couleur. Par esprit de provocation, nous pourrions dire alors que l'acte de « création » dans Photoshop consiste à définir la taille de l'image, le reste n'étant que du coloriage.

Une fois l'image importée ou construite, Photoshop offre un certain nombre d'opérations discrètes sur elle. C'est ici que le logiciel ressemble à n'importe quel tableur comme VisiCalc ou Excel. On peut sélectionner une partie de l'image jusqu'au pixel près, ou sélectionner l'ensemble des pixels, et appliquer sur ces valeurs des soustractions, des multiplications, voire des opérations algorithmiques complexes. En changeant les valeurs de chaqun des pixels, on change son apparence. On peut choisir uniquement les valeurs représentant le rouge d'un ensemble de pixels; en augementant la valeur de rouge (+50, par exemple) on change la température colométrique de l'ensemble de l'image. Ce jeu de discrétisation — où l'on peut modifier un aspect de l'image sans modifier son ensemble (pixel, couleur, zone) — s'applique partout dans Photoshop. À chaque mise-à-jour du logiciel, l'éditeur rajoute d'ailleurs de nouvelles formes de traitement discret sur l'image — le plus important étant l'introduction des « calques » superposées mais discrétisées dans la version 3.0. Comme dans VisiCalc, on peut sélectionner n'importe lequel de ces entités, et affecter les valeurs incluses sans affecter les voisins. Les relations analogiques internes de l'image sont modulaires.

C'est cette possibilité accrue de manipulations tous azimuts qui a donné le sentiment que tout depuis est manipulable, et que la manipulation est désormais présente dans toute image comme valeur par défaut :

Dans la nuit numérique, le toucher s'estompe, la chaîne se complique. Elle ne disparaît pas tout à fait : c'est encore une photo. Mais quelque chose est intervenu, le traitement comme calcul binaire, qui rend la transmission incertaine. La numérisation rompt la chaîne, elle introduit la manipulation à même le spectrum, et du même coup, elle rend indistincts fantômes et phantasmes. Les photons deviennent des pixels eux-mêmes réduits en zéros et uns sur lesquels peuvent être effectuées des calculs discrets. D'essentiellement indubitable lorsqu'il est analogique (quelle que soit sa manipulatibilité accidentelle), le ça a été est devenu essentiellement dubitable lorsqu'il est numérique (c'est la non-manipulation qui devient accidentelle).

–; L'image discrète ; 1996 ; pp. 172 Bernard Stiegler

Plus nous avançons dans l'histoire des traitements numériques, nous apprenons au contraire que ces traitements discrètes forment de nouveau tissus de rapports analogiques internes repérables, et qui sont plus en plus repérables même dans leur historique de traitement. On apprend de plus en plus à lire dans une image tel ou tel algorithme, à en extraire alors l'historique des manipulations, ou en tout cas à repérer qu'un algorithme quelconque a touché l'image — c'est-à-dire qu'il y a eu manipulation discrète d'une partie de l'image.

cf. tableau, décalcage, Autoshop, Carbon (cf. zigzag), remap, Images photographiques, tableau